医療業界、生成AI利用の規制対象データ違反89%に 米ネットスコープ調査

掲載日:

米クラウドサービスのネットスコープは18日、医療業界を対象にした年次脅威レポートを公表した。生成AI(人工知能)やクラウドサービスの活用が広がる一方、患者情報など規制対象データの漏えいリスクが高まっていると指摘した。医療業界で生成AI利用時のデータポリシー違反に占める規制対象データの比率が89%に達し、全業界平均の31%を大きく上回っていることが明らかになった。

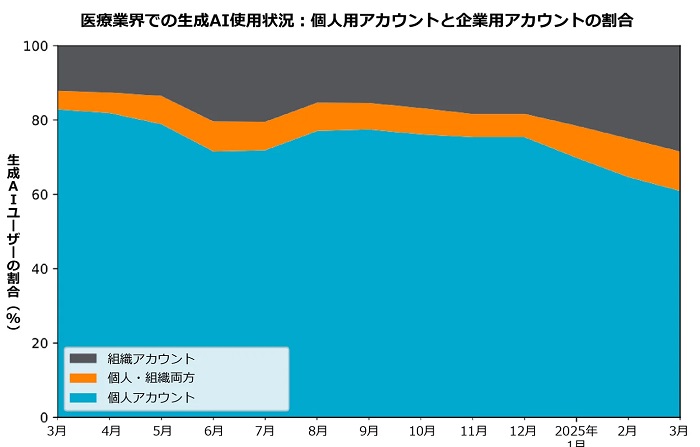

レポートでは、医療業界で従業員が個人アカウント経由で生成AIを利用する、いわゆる「シャドーAI」が引き続き課題となっているとした。調査対象期間中に、医療業界の従業員の43%が個人アカウントの生成AIを業務で利用していたという。一方、組織管理下にある承認済み生成AIアプリの利用率は18%から67%に上昇しており、利用環境の整備も進んでいる。

院内で利用する独自AIツールやAIエージェントは、外部の基盤モデルやAPI(アプリケーション・プログラミング・インターフェース)と接続して稼働する例が多いという。医療業界では、米オープンAIへのAPIトラフィックが63%、音声AIの米アセンブリーAIは62%、米アンソロピックで36%を組織内の利用状況で確認した。AI活用が診療支援や事務、運用管理など幅広い領域に広がっている実態がうかがえるとしている。

個人向けクラウドサービスを通じた情報漏えいリスクも目立つ。個人用クラウドアプリに関連するデータポリシー違反の82%は、患者情報など規制対象データに関わるものだったという。その防止には、未承認サービスへのアップロード時に警告を出す仕組みや、個人アカウントへのファイル送信を遮断する制御が有効だとした。また、過去1年間にこうした対策を導入した医療機関の56%が、個人のグーグルドライブへのアップロードをブロックしていた。

外部脅威への対応の重要性も言及。攻撃者がクラウドアプリを悪用してマルウエアを配布する事例が続いており、悪用先としてマイクロソフト(MS)の「アジュール・スタティック・ウェブ・アップス」や「ワンドライブ」、ギットハブなどが確認された。ネットスコープでは、クラウド活用の拡大が業務の効率化につながる半面、外部攻撃と内部リスクの双方を踏まえた対策が求められると指摘している。